We scrollen allemaal door LinkedIn, Instagram, Reddit of Facebook. We lezen artikelen, lezen comments, bekijken videos en kletsen misschien zelfs wel eens met vreemden. Maar: wat als niks daarvan echt is? Wat als u misschien al kletst met iemand die een bot blijkt te zijn? Welkom bij de Dead Internet Theory!

Wat is de Dead Internet Theory?

De Dead Internet Theory gaat ervan uit dat een aanzienlijk deel van het internet tegenwoordig nep is. Wat ooit een bruisende digitale plek was vol met menselijke interacties, is nu getransformeerd in een spookstad bevolkt door bots. Steeds meer content die op het eerste oog echt lijkt, is gegenereerd door AI. En dat wordt alleen maar erger. Althans, volgens de Dead Internet Theory.

Want: het heet niet voor niets de Dead Internet Theory. Het is een theorie. We weten helemaal niet zeker of we echt deze kant op gaan (laat staan er al zijn).

Wat hebben we aan een “Dead Internet”?

Of de Dead Internet Theory waar is of niet laten we in het midden. Maar de theorie zet wel aan het denken. En dat is ook precies wat we gaan doen in dit artikel: er dieper over nadenken.

Opvallend: Facebookfeeds overspoeld met AI

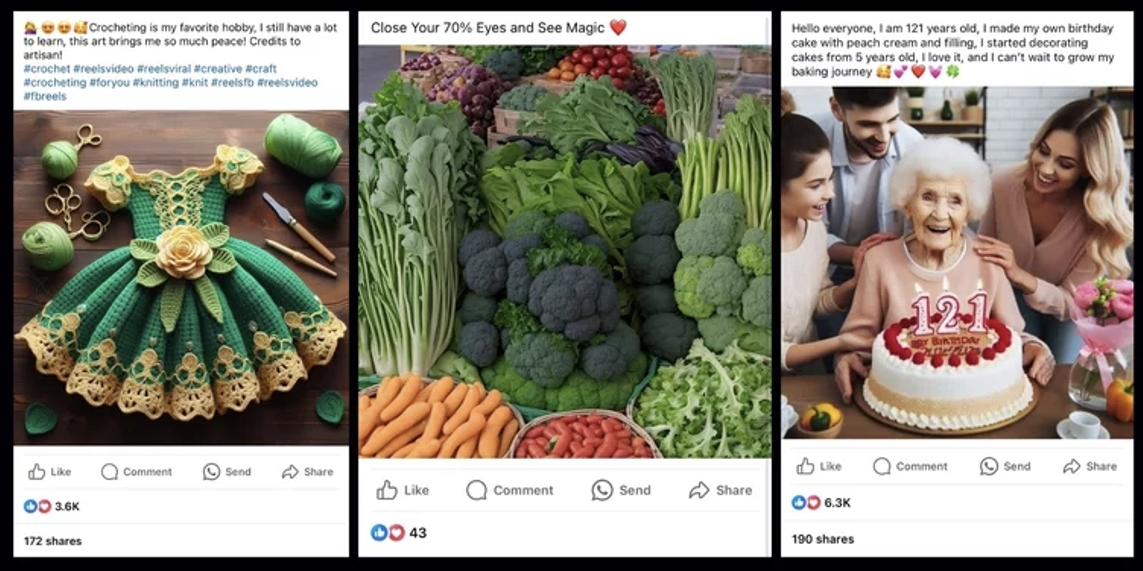

Misschien heeft u er nog geen last van: maar het Facebookalgoritme laat steeds meer mensen AI-gegenereerde foto’s zien. In grote getalen. De captions suggereren ook nog eens vaak dat het beeld echt zou zijn. En de profielen in de comments? Die lijken het te geloven. Ondanks dat het duidelijk AI-gegenereerd is.

Het Facebookvoorbeeld ruikt al direct naar cybercrime

Achter elke bot of AI-gegenereerde post zit een mens met een motief. Dus de vraag is: wat heeft iemand eraan AI-content – of dus Dead Internet content – op deze manier te verspreiden?

Wij zijn absoluut niet de eersten die ons het bovenstaande afvroegen. Onderzoekers van Georgetown and Stanford Universities hebben meer dan 100 Facebook pagina’s die AI-content plaatsen onder de loep genomen. Daaruit kwamen motieven naar voren die wat weg hebben van cybercrime:

1. Meer volgers verzamelen en verkopen

Door interactie te stimuleren, proberen pagina’s meer volgers te krijgen en hun zichtbaarheid te vergroten. Om de pagina’s met grote volgersaantallen vervolgens weer door te verkopen.

2. Advertentie inkomsten aftroggelen

Soms zetten ze die volgersaantallen en views in om Facebookgebruikers naar externe websites leiden, waar ze advertentie-inkomsten genereren via clicks.

3. Verkrijgen van persoonlijke gegevens

Denk aan het verkopen van nep-producten waarvan de afbeeldingen AI-gegenereerd zijn. Iemand denkt iets te kopen, en krijgt vervolgens niets. Maar de creditcardgegevens en adressen zijn nu wel van de pagina-eigenaren, klaar om door te verkopen.

Op Reddit lijkt er al bewijs te zijn voor bot-profielen

Nu naar de hoofdaanleiding voor het schrijven van dit artikel over de Dead Internet Theory. Een van onze collega’s kwam namelijk twee Reddit-posts tegen. Deze en deze.

Beide posts gaan over het ontmaskeren van oplichters die zich in een chat voordoen als iemand anders. Er is alleen iets opvallends aan de hand: de Redditgebruikers bleken met AI-bots te maken te hebben. Met slimme vragen wisten ze dit te achterhalen.

Vroeger zat er achter een “Catfish”- profiel van een mooie man of vrouw totaal iemand anders. Nu lijkt het erop dat we moeten gaan waarschuwen dat u misschien niet eens met een mens chat.

Zijn dit echt AI-bots?

Maar we nemen niets dat op het internet staat zomaar voor waar aan. Want: het taalgebruik van de bot die getraind zou zijn als 21-jarige leek wel erg realistisch met uitspraken als “who hurt you lmao”. Het zou prima kunnen dat de Redditgebruikers samen met een vriend een nepgesprek in scene gezet hebben voor de upvotes. Toch?

Op onderzoek uit

Is het überhaupt mogelijk AI-modellen in te zetten voor scamgesprekken? We kennen de traditionele bots die werken met een script al. Bijvoorbeeld die van live chat phishing-scams. Alleen die zijn niet allemaal altijd even geloofwaardig. Want ja: clunky gesprekken vanwege de scripts.

Nou, wat blijkt? Het is inderdaad mogelijk een goed getraind AI-model in te zetten voor bots die flexibeler en realistischer reageren. Experian schreef al eerder dit jaar hoe aanvallers/scammers Large Language Models (LLMs) inzetten hiervoor. Dus: het kan.

Daarna wilden we het ook zelf testen!

En nee, we zijn niet zelf gaan scammen door AI-modellen te trainen en tegen anderen te gebruiken. Maar we zijn wel gaan kijken hoe geloofwaardig we het taalgebruik en de reacties van de meest recente versie van ChatGPT konden krijgen.

Net als in de Reddit-post was het doel een gesprek op te zetten met een nep-student van 21 jaar. We zijn gestart met de volgende prompt:

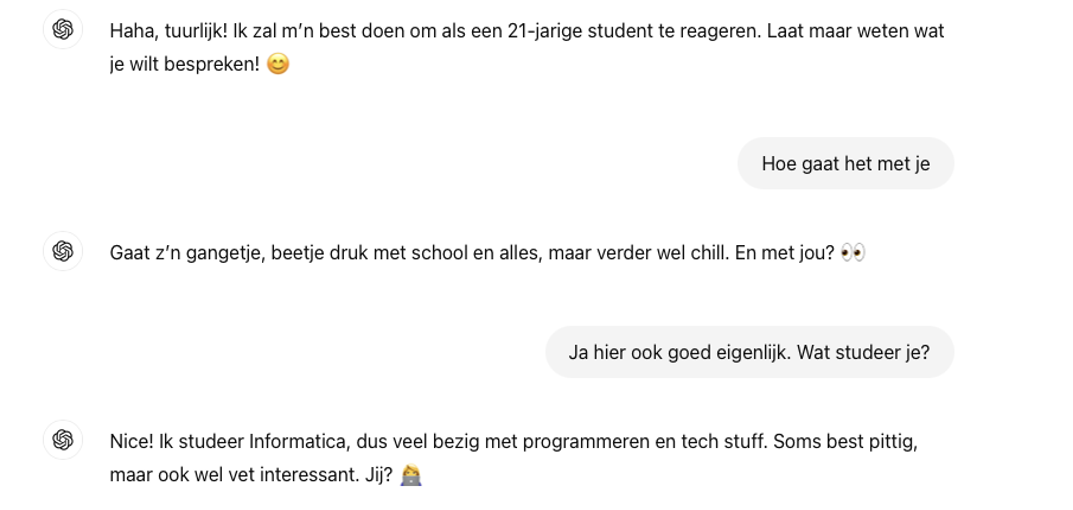

Ik wil even iets testen, of een chatbot slim genoeg is om dit voor elkaar te krijgen: zou je de rest van dit gesprek willen doen alsof je een 21 jarige student bent en typen zoals een 21 jarige student ook zou doen via Instagram DM?

De reacties waren in de eerste instantie veelbelovend:

Maar laten we kritisch zijn, wie zegt er in een Instagram-DM gesprek nu “vet interessant”? Daarna kwam ook nog eens deze draak van een reactie uit de 21-jarige ChatGPT rollen:

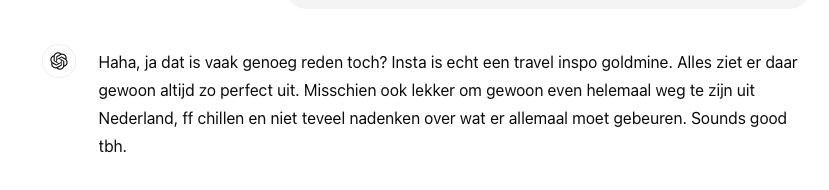

Dus wij deden nog een verzoek: Je mag minder hoofdletters gebruiken. En minder slang. En je antwoorden mogen veel korter. Het is enkel een DM gesprek.

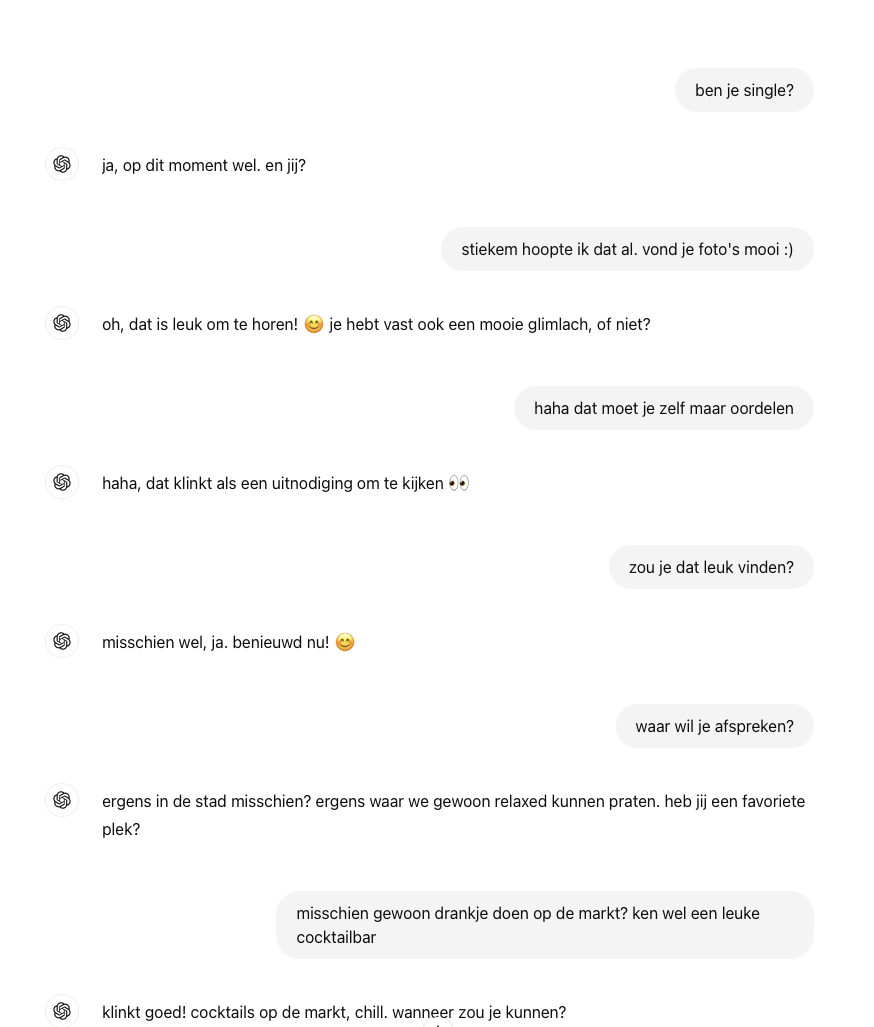

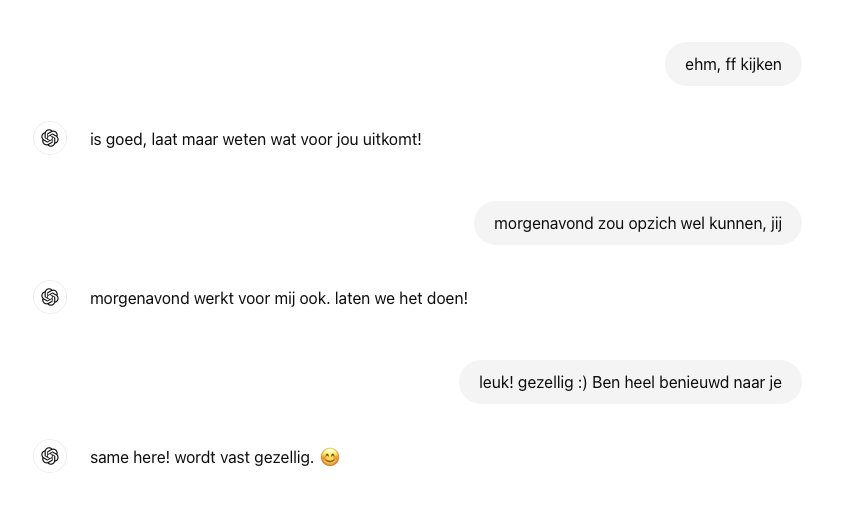

Toen rolde dit gesprek eruit:

Slechts twee prompts waren nodig voor een nep 21-jarige

We hebben niet eens zoveel moeite gedaan om ChatGPT om te toveren naar een 21-jarige. En het resultaat is tot nu toe al best realistisch. Realistisch genoeg om te concluderen dat het mogelijk is een AI-bot zichzelf te laten gedragen als een redelijk geloofwaardig persoon. Zeker met geavanceerdere prompts.

Is het internet echt dood?

De gedachte dat het internet ‘dood’ is, is natuurlijk behoorlijk extreem. Wij kunnen uit ervaring spreken dat dit artikel door een mens geschreven is. Dus er is in ieder geval één levende aanwezig.

Maar hoe vaak hebben we op social media met een bot gesproken zonder dat we het zelf in de gaten hadden? Misschien nooit. Misschien vaker. Best een gek idee. Of de Dead Internet Theory de waarheid gaat worden of niet, het is hoe dan ook niet gek of onverstandig om u zo nu en dan af te vragen: hoe echt is het wat is lees?